A inteligência artificial (IA) está prestes a assumir um papel inovador nas plataformas online, e o protagonista desse avanço é o GPT-4. Sob o comando da OpenAI, este modelo de linguagem poderá em breve desempenhar o papel de moderador virtual, embarcando em uma missão contra o conteúdo prejudicial que permeia a internet.

A busca pela eficácia na aplicação das políticas das plataformas digitais encontra um aliado que até pode deixar a moderação de plataformas mais prática e rápida, mas levanta dúvidas sobre a efetividade dessa moderação.

Será que o GPT-4 também vai “mentir” nos resultados, produzindo falsos positivos tal e como acontece nas respostas do ChatGPT? Se sim, ele será um enorme problema para os usuários.

GPT-4 para moderar conteúdo online

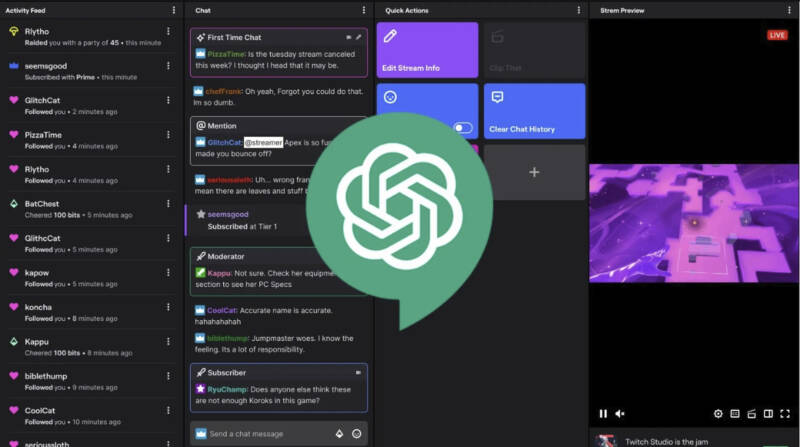

No cerne dessa potencial revolução está o GPT-4, o cérebro por trás do ChatGPT Plus, a versão premium do assistente de conversação desenvolvido pela OpenAI. Na prática, ele será utilizado para supervisionar fóruns e redes sociais, detectando e combatendo o conteúdo nocivo publicado pelos usuários.

Essa perspectiva surge a partir de uma publicação recente no blog da OpenAI abordando o assunto. A moderação de conteúdo, uma tarefa vital para a saúde das plataformas digitais, pode passar por uma revolução caso a ideia seja implementada e funcione em larga escala.

O GPT-4 pode inclusive acelerar as mudanças de política de uso das plataformas de meses para apenas algumas horas. A dinâmica muda drasticamente quando as capacidades da IA são aproveitadas, substituindo os moderadores humanos que há tempos são encarregados de peneirar o vasto oceano de informações em busca do material tóxico. O processo, já intrinsecamente moroso, muitas vezes impõe um ônus mental sobre esses trabalhadores.

O enfoque na IA como moderador não é obra do mero acaso, e há uma série de vantagens em jogo. A agilidade na adaptação às alterações de política é apenas uma delas, reduzindo a linha do tempo de implementação das mudanças. O GPT-4 possui a capacidade única de compreender e aplicar as nuances das diretrizes de políticas, podendo se ajustar instantaneamente a atualizações e resultando em um processo de moderação meticuloso e preciso.

Em um cenário em que equipes de moderação atribuam etiquetas a conteúdos específicos para indicar sua conformidade com as regras da plataforma, o GPT-4 poderia, por si só, aplicar tais etiquetas a partir do mesmo conjunto de dados, sem qualquer conhecimento prévio das respostas.

A etapa seguinte é um teste de fogo para o GPT-4, quando os moderadores humanos entram em ação, comparando as duas séries de etiquetas. As divergências se tornam oportunidades de aprendizado, ou um modo de aprimorar a clareza das regras.

Tudo muito incrível, certo?

Então… você já pode imaginar que rumo esse artigo vai tomar a partir de agora.

A Open AI terá trabalho para fazer tudo isso funcionar

Como qualquer avanço disruptivo no mundo da tecnologia, a introdução da IA como moderador não está isenta de problemas e desafios de implementação.

Enquanto a perspectiva de melhores condições de trabalho para os moderadores humanos e um alívio do fardo mental é tentadora, surge a temida questão da substituição de empregos. A ironia inescapável é que a mesma tecnologia que promete aliviar o cansaço humano também pode dar origem à angústia da perda de empregos, em vez de uma mera realocação para outras funções.

A OpenAI, embora não mergulhe de cabeça nesse espinhoso dilema em sua publicação, deixa claro que o monitoramento, a validação e o refinamento dos resultados da IA são essenciais. A participação humana continuará a ser um farol orientador, especialmente em casos complexos que demandam discernimento humano.

A redução do papel humano em algumas áreas do processo de moderação permite que recursos preciosos se concentrem na abordagem dos desafios mais complexos e extremos, essenciais para a evolução contínua das políticas.

A intrigante ideia de empregar a Inteligência Artificial para aliviar a árdua tarefa dos moderadores e fortalecer a segurança nas plataformas digitais certamente desperta curiosidade e, ao mesmo tempo, apreensão entre os profissionais.

À medida que essa transformação se desdobra, a grande questão que paira é: como a IA se sairá na compreensão do matiz e contexto linguístico? A ausência de intervenção humana pode ser prejudicial, especialmente quando a delgada linha entre permanecer em uma plataforma de chat ou ser expulso dela é desenhada pelo contexto sutil das palavras.

Enquanto a incerteza paira, é certo que a interseção entre IA e moderação está moldando um novo capítulo na evolução das plataformas digitais, apresentando uma nova dinâmica em um campo onde a presença humana é essencial para preservar o bom ambiente em serviços online muito utilizados pelos usuários.